ISSN 2095-8870 CN 31-2107/G3

2024年3月,英国凯特王妃发布视频声明,宣称自己正在接受癌症治疗,在该视频发布后,网络上就出现了质疑凯特发表声明的视频是用AI合成的说法。早前,关于凯特王妃被媒体拍到同母亲驾车外出的照片、母亲节亲子合照、外出购物视频也同样被质疑,掀起全民辨识真假的热潮。深度伪造技术的开源,让人工智能“换脸”一时大兴其道,这一技术算法的日趋成熟,无论是人像还是声音、视频都可以被伪造或合成,甚至可以达到不能辨别真伪的程度。随着生成式人工智能开始走向大规模应用,潜在的虚假信息风险增加,判断资讯内容的真实与虚假,已成为重要课题。对于任何关于公众人物的疑似深度伪造内容,应当谨慎对待,并通过可靠的事实核查和专业的技术分析来验证其真实性。

人工辨识技巧

随着生成式人工智能的进步,原先传统的辨识方法(如在深度伪造视频中寻找人物不自然的眨眼模式)已不再适用,但还是可以通过一些技巧看出视频/图片中的端倪。咨询公司 Latent Space Advisory 创始人、生成式人工智能领域的著名专家亨利·艾德(Henry Ajder)认为AI生成图片/视频会有一些特点,比如气泡、超现实背景、人物牙齿尺寸、头发形状不自然等,艾德建议:可以观察脸部皮肤,AI技术产生的人物照片中的皮肤看起来通常会过于平滑与光亮;可以观察影像中的光线照射是否一致,有时人物看起来非常逼真,但背景却显得不够真实;可以细心观察脸部的边缘,脸部肤色是否与其他身体部位相符,脸的边缘是否过于锐利或模糊;还可以观察影片中人物的牙齿是否清楚或只是模糊的一片,目前AI演算法对于牙齿部分的处理还不够成熟,无法精准呈现每一颗牙齿,因此牙齿也是一项识别AI深伪的重要线索。总之,透过各种细节来识别AI换脸的痕迹,避免陷入“AI换脸技术”的陷阱。

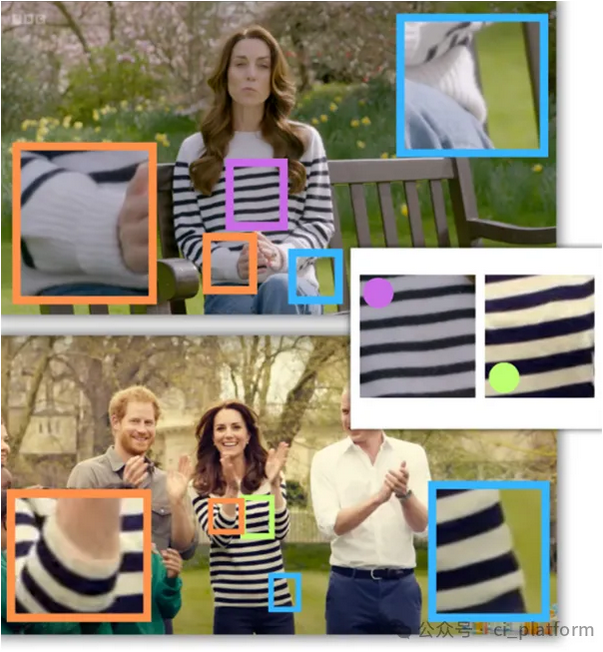

造型与历史视频相似:凯特王妃在视频中的服装和发型与七年前的造型几乎一模一样,引发了关于视频是否为A合成的疑问。

戒指的时隐时现:视频中凯特王妃手上的戒指在某些镜头中出现,在某些镜头中又消失,这种不一致性被认为是A合成时可能出现的错误。

背景的不自然:视频中的背景花草没有风吹草动的迹象,这与自然环境的正常状态不符,引发了对背景真实性的怀疑。

衣服的延伸:视频中凯特王妃所穿上衣的条纹延伸到了视频画面中的长凳上,这可能是Al合成过程中的失真。

演讲风格的改变:凯特王妃在视频中的演讲被指出与她以往的风格不符,她通常需要看稿,而视频中她似乎是脱稿演讲。

而上述质疑也有对应的解释,如网传7年前的上衣无论是在版型还是纹路上与近日凯特王妃发表声明视频中所穿的条纹上衣都有明显不同;戒指的时隐时现可以用影像作品中快速移动的物体可能产生“动态模糊”的原理来解释;所谓“衣服的延伸”,可能是由于凯特王妃所坐的长凳表面可能涂抹了清漆,其亮面在阳光下反射出了衣服的倒影。在放大细节后可以观察到,凯特上衣的花纹与长凳上的倒影并无连接,等等。因此,通过人工辨识图片/视频的真伪只能做初步的判断,还需要借助专业工具来检测。

检测工具

诸多人工智能机构都竞相开发了深度伪造检测工具,从细微灰度变化、动作一致性程度、血液流动情况等不同角度进行判断,如微软的微软视频AI认证器Microsoft Video Authenticator,该工具可以分析视频和静态照片,检测正常人眼通常无法察觉的细微灰度变化,并为快速检测深度伪造提供实时置信度评分;FaceFirst的深度伪造检测工具FaceFirst Forensics能够识别面部动作的自然性和一致性,来检测和验证深度伪造内容;英特尔的深度伪造检测工具FakeCatcher可以通过研究面部颜色变化来推断血液流动;纽约布法罗大学(University at Buffalo)计算机科学家吕思维(Siwei Lyu)团队开发的公共算法存储库 DeepFake-O-Meter可以从视觉、听觉和语义等不同角度分析视频内容以嗅出深度伪造内容。

针对凯特王妃的视频,英国 “团结新闻网”称他们使用isitai网站上的图片检测工具测试了视频中的一帧,结果显示该画面有96.02%的可能性是人工智能生成的,而使用AI检测工具Deepware对视频进行分析后,结果显示视频中没有检测到深度伪造(deepfake)的成分。由此可以看到,通过检测工具来论证视频是否由AI生成,并不能得到统一的结论,一方面,检测工具所使用的训练数据集可能并不包括从视频上截取的关键帧,因而未必适用于对关键帧的检测,另一方面,目前市面上的绝大多数AI检测工具都不能保证其检测结果准确。

小结

虽然检测工具/技术的机器学习模型是在大量图像数据集基础上训练出来的,但它们并不完美,在某些情况下,工具/技术可能会产生不准确的结果。因此,人工核查仍然是重要的前提和补充,特别是在处理复杂或边界情况时。对于情报研究人员来说,深度伪造技术的快速发展给情报分析带来了威胁与挑战,深度伪造内容隐藏着诸多情报风险,以假乱真的虚假情报信息可能会给情报决策带来干扰。因此,情报研究人员不仅需要掌握各类技巧进行人工的事实核查,还需要借助深度伪造检测技术以及专业的技术分析,双重验证情报内容的真实性。

参考文献:

澎湃新闻.骗过百万网友的AI照片,你分辨得出来吗?[EB/OL].[2022-09-06].https://finance.sina.com.cn/jjxw/2022-09-06/doc-imqmmtha6168473.shtml

老年微观.一个技术窍门:如何识别人工智能生成的假图像[EB/OL].[2024-03-23]. https://baijiahao.baidu.com/s?id=1794245283703952046&wfr=spider&for=pc.

ABPlive.Fact Check: Princess Kate's Video Revealing Cancer Diagnosis Is Not AI-Generated Deepfake[EB/OL].[2024-03-23]. https://images.app.goo.gl/SQtx3SpecKqXUm2t5.

郑淑婧.明查|英国凯特王妃发布患癌声明的视频是用AI合成的吗?[EB/OL].[2024-03-30].https://www.thepaper.cn/newsDetail_forward_26858427.

Eisenstein M. Seven technologies to watch in 2024[J]. Nature. 2024 Jan;625(7996):844-848.

知新了了.12家公司竞相开发人工智能深度伪造探测器[EB/OL].[2023-05-29].https://new.qq.com/rain/a/20230529A07RXZ00.

Gartner Predicts 30% of Enterprises Will Consider Identity Verification and Authentication Solutions Unreliable in Isolation Due to AI-Generated Deepfakes by 2026[EB/OL].(2024-02-01). https://www.gartner.com/en/newsroom/press-releases/2024-02-01-gartner-predicts-30-percent-of-enterprises-will-consider-identity-verification-and-authentication-solutions-unreliable-in-isolation-due-to-deepfakes-by-2026.

易侃,徐欣. 开源情报可信分析系统的关键模型与技术[J]. 指挥信息系统与技术, 2023,14(1):48-56.

Kyle Wiggers.OpenAI built a voice cloning tool, but you can’t use it… yet[EB/OL].[2024-03-30].https://techcrunch.com/2024/03/29/openai-custom-voice-engine-preview/.